【イベントレポート】ユヴァル・ノア・ハラリ氏特別対談イベント(2025年3月16日開催)

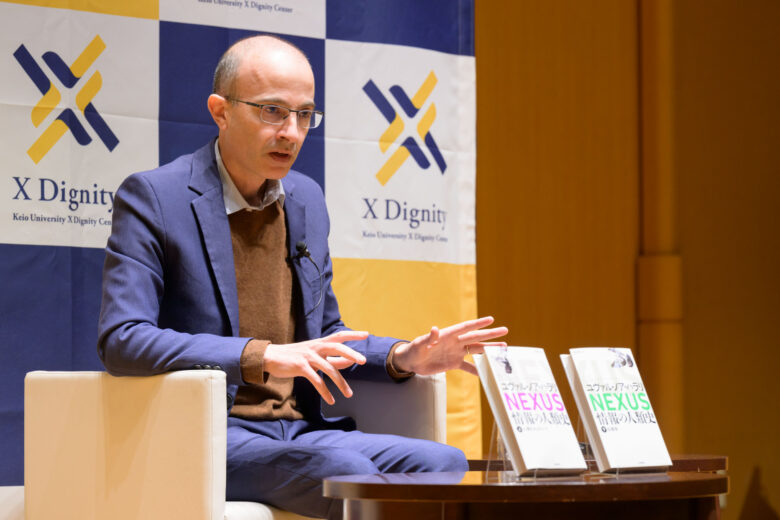

2025年3月16日、慶應義塾大学三田キャンパスにて、歴史学者であり『サピエンス全史』の著者であるユヴァル・ノア・ハラリ氏を迎え、「AI時代の人間の尊厳〜新たな『NEXUS』を展望する〜」と題した特別対談が開催され、会場には慶應義塾の一貫教育校の生徒や学部生、院生、教職員など約200名が集まり、熱気あふれる議論が繰り広げられました。

- 【開催概要】

「AI時代の人間の尊厳 新たな「NEXUS」を展望する」

主催:慶應義塾大学X Dignityセンター, 河出書房新社

場所:慶應義塾大学三田キャンパス北館ホール

日時:2025年3月16日(日) 10:45~12:05

【プログラム】

10:45-10:50 開会挨拶 山本龍彦, 慶應義塾大学大学院法務研究科教授/X Dignityセンター共同代表

10:50-11:25 対談

ユヴァル・ノア・ハラリ, 歴史学者/哲学者

伊藤公平, 慶應義塾塾長

11:25-12:05 学生との質疑応答

■開会挨拶

山本龍彦/ 慶應義塾大学大学院法務研究科教授, X Dignity センター共同代表

AIが新たな「メンバー」として加わった現在の情報ネットワーク時代において、私たちは、私たちの「注意(アテンション)」を引くよう巧妙に設計されたアルゴリズムにより、刺激的・煽情的な偽・誤情報やや憎悪的な表現に絶えず晒されています。こうした状況にあって、少なくとも私には、AIを含む高度情報技術が私たちの「尊厳」を真に向上させているようには感じられません。世界に目を向けても、自分が自分らしく生きることを保証しようとしてきたリベラル・デモクラシーという「物語」が、アルゴリズムを武器としたいくつかの企業や超大国の力によって激しい攻撃を受けているように思います。この流れが加速すれば、最終的に私たちは、道具であったはずのAIに逆に利用され、私たち人間の尊厳が軽視された非人間的な世界が到来するかもしれません。

慶應義塾を創立した福澤諭吉は、「独立自尊」、すなわち自他の尊厳を重んじました。福澤は物理学や情報技術などの科学の発展を尊重し、それらを学問の基礎と捉えつつも、科学技術に溺れることなく、真理と秩序のバランスを重視した文明の主体的な構築を目指しました。 昨年、慶應義塾大学では、人間とマシンなど、さまざまな領域が「X(クロス)」するAI時代において、尊厳の意味を根本的に問う学際的な研究機関として、「X Dignityセンター」が立ち上がりました。本日は、人類の歴史を「情報ネットワーク」の視点から描いた新著、「NEXUS 情報の人類史」を上梓したばかりの歴史学者、ユヴァル・ノア・ハラリ教授をお招きし、量子コンピュータの分野を牽引する物理学者でもある伊藤公平塾長とともに、人間の尊厳に配慮した新しいNEXUS(繋がり)の可能性を探っていきたいと思います。

■対談

ユヴァル・ノア・ハラリ/歴史学者,哲学者

伊藤公平/慶應義塾長

早すぎるAI開発

塾長

私が慶應義塾大学の塾長に就任した4年前、大学の図書館には塾長推薦の必読書を陳列する棚が設けられましたが、その棚の真ん中に置いたのがあなたの『21 Lessons』でした。その中で、3つの大きな世界的脅威について述べています。

1つ目は核戦争。2つ目はバイオテクノロジーの無秩序な進歩。そして3つ目がITや情報ネットワーク、AI。しかし今回の『NEXUS情報の人類史』では、IT、情報ネットワーク、AIに焦点をあてていますが、その意図を教えてください。

ハラリ氏

AIとバイオテクノロジーを比較した際、明らかなのは、AIの方が進歩のスピードが圧倒的に速いことです。バイオテクノロジーも世界を劇的に変えることができますが、その進歩にはもっと時間がかかります。AIの進歩は生物学的進歩の何百万倍もの速さで進んでいます。

AIを核戦争と比較した場合、核戦争には何のメリットもないことが断定できます。今日の世界では、ロシアのような大国が国際秩序を完全に無視しています。1945年以降、強い国が弱い国を侵略し、破壊することは最大のタブーとされてきましたが、これは破られました。核戦争にメリットは皆無です。一方AIの場合は、潜在的な可能性が非常に大きいため、危険性を把握するのが難しく、複雑な存在です。

AIの重要な点は、それが悪ではなく異質な存在であるということです。AIは多くの点で超人的な知性を持ちますが、人間ではありません。AIは人間の知能を超えるでしょうが、本質的には異質なものです。そのため、AIがどう発展し、どのような結果をもたらすかを予測するのが困難です。

もうひとつ言えるのが、AIは道具ではなくエージェントであることです。道具を使うかどうかは、私たちが決められます。これまでは人間だけが判断を下し、新しいアイデアを発明することができました。AIは、私たちの助けも介入もなしに、自ら意思決定ができる最初のテクノロジーです。AI兵器は、人間の指示を必要としません。何を爆撃するかを自分で決めることができます。それだけでなく、新しい武器や新しい軍事戦略を発明することもできます。同時に、新しい医薬品やがんの治療法を発明することもできます。このようにAIには計り知れない可能性があります。

今回、情報技術に焦点を当てることにしたのは、それが現在、私たちが直面している最大の課題だからです。何千年もの間、私たちは地球を支配し、知性においても発明する能力においても、地球上の何ものも、私たちに太刀打ちできませんでした。しかし、おそらく数年以内に、私たちを凌駕し、医薬品から兵器に至るまで、あらゆるものを発明するAIが出てくるでしょう。

塾長

数年以内にとおっしゃいましたが、2015年に出された『ホモ・デウス』の中で既にあなたは、この情報技術の進歩に対して警告を鳴らしていました。その時と比べてどう変わりましたか?

ハラリ氏

10年前に私が『ホモ・デウス』を書いたときは、何百年後に起こるかもしれない、これは哲学的推測のようなもので、私たちの生活への直接的な影響はほとんどないだろうと考えていました。しかし今、アメリカや中国の企業でAI開発に取り組んでいる人たちに話を聞くと、彼らは1年以内、あるいは5年以内にAGI(汎用人工知能)を手に入れられると言います。つまり、開発の速度は劇的にスピードアップしているのです。

また、AGIへの規制や合意に関する話し合いは今や極めて難しくなりました。先のアメリカ選挙以来、AI開発リスクをどう管理するかについての世界的合意の可能性は消え失せたと感じています。AI開発をリードする、Open AIやMicrosoft、テンセント、バイドゥといった企業の人たちと話をするとき、私は2つの質問をします。ひとつは、「なぜそんな急いで進めるのか?」AIに大きなメリットがあることは理解していますが、一方で人類滅亡を想起させるリスクもあります。人間は非常に適応力の高い生き物ですが、もっと時間が必要です。

彼らは言います。「私たちはペースを落としたいができない。なぜなら、もし私たちがスピードを落としたら、競争相手が勝ち、最も冷酷な人間が世界を支配することになる。私たちは他者を信頼できないので、より早く進めなければならない。」

もうひとつの質問は、「あなたたちが開発している超高知能AIを信頼できますか?」すると彼らははい、と答えます。他の人間は信用できないと言っていた人たちが、AIは信用できると言うのです。

何千年もの間、人類は互いを信頼することを学んできました。世界貿易ネットワークは、地球上の80億人をつないでいます。多くの場合、私たちの食べ物、服、薬は、地球の反対側にいるだれかによって作られています。そこには信頼があります。しかし、AIとの経験はまだありません。彼らが何を開発するかわかりません。高知能AIが互いに、そして何百万という人間と繋がった時に何が起こるのか、私たちには想像もつきません。AIは人間の仕事を奪い、国を乗っ取る可能性も持っています。私たちはもっと恐れてもいいはずです。そしてより重要なことは、高知能AIを開発する前に、人間同士の信頼関係をどう回復するかということです。

エリートの役割と教育機関に求められるもの

塾長

いわゆるエリートと呼ばれる人たちと非エリートとの間の分断をどう見ていますか?

ハラリ氏

多くがそうであるように、この区分にも誤解があります。イーロン・マスクやドナルド・トランプといった億万長者たちが、自分たちはエリートに反対だと主張しています。アメリカ政府を牛耳っている世界一の金持ちたちが、自分たちはエリートではないと言うのです。つまり、エリートという言葉は、政治的ライバルにつける否定的な言葉なのです。どんな集団にもエリートは存在します。より才能のある人、より権力を持つ人、より影響力のある人は必ずいます。これが人間社会の本質です。問題はエリートの存在ではありません。集団の中で最も影響力を持つ人たちが、自分たちの利益のためだけに権力を行使することが悪いのです。より多くの影響力・権力を持つ人たちは、その力を社会のために使うべきなのです。

エリートのいない社会は幻想です。エリートのいない完全に平等な社会を作るための最大の実験が共産主義であり、それがどのような結果をもたらしたか、私たちは知っています。これは我々が目指すべきものではありません。すべての大学・研究機関にとって求められるのは、エリートをなくすことでも、エリートと非エリート間の障壁を取り払うことでもなく、社会と人々の利益のため力を行使するエリートを生み出すことです。

塾長

私たちのような教育機関はどうあるべきでしょうか? 人間の知的能力を維持させるための教育の役割とは何でしょうか?

ハラリ氏

かつての教育機関は、人々に情報を提供することを主な役割としていました。町には図書館が1つしかなく、本の数も限られていました。今はまったく逆です。膨大な量の情報であふれています。ここで理解しておくべきことは、多くの情報は真実ではなく、真実は情報のうち僅かしかないということです。ほとんどの情報がジャンクであり、フィクションであり、ファンタジーであり、嘘であり、プロパガンダです。真実は高くつきますが、フィクションは安い。何かについて真実を書きく場合、調査、分析、事実確認に時間をかける必要があります。時間と労力とお金がかかります。反対にフィクションはとても安い。頭に浮かんだことを書くだけでいいのですから。

また、現実は複雑です。フィクションは、創作するだけでできるので、いくらでもシンプルにできます。そして最後に、真実はしばしば痛みを伴います。常にではありませんが、現実には目を背けたい部分もあります。現実のすべてが楽しくて心地良いものなら、セラピストは必要ありません。真実は時に痛みを伴います。つまり、高価で複雑で痛みを伴う真実と、安価でシンプルで魅力的なフィクションの競争では、フィクションが勝つのです。そして、世界は膨大な量のフィクションで溢れかえっています。

教育機関、報道機関にとっての役割は、人々に多くの情報を提供することだけではありません。私たちは情報を持ちすぎています。彼らの役割は、情報の海の中から希少な真実の宝石を見つけ出し、その違いを見分ける方法を提供することです。歴史家として、私が学生に教えていることは、過去についての事実ではありません。それはネットで調べればわかります。彼らが歴史学で学ぶ必要があるのは、信頼できる史料と信頼できない史料をどう見分けるかなのです。

目の前のTikTokの動画を信用していいか、どう見分ければいいのでしょうか。千年前の文書を見つけた時、そこに書かれたことを信じるべきかどうか、どうやって判断するのでしょうか。千年前にも人は嘘をついていました。重要なのは、より多くの情報を得ることではありません。信頼できる情報と信頼できない情報の違いをどう見分けるかなのです。これはどの分野でもいえることです。

人間同士の信頼関係を取り戻す

塾長

『NEXUS情報の人類史』を読んで、複雑な感情を抱きましたが、同時に、まだ遅くはないという希望も持ちました。山本教授が述べたように、慶應義塾では「X Dignityセンター」という研究拠点が立ち上がり、まさにこの問題に取り組もうとしています。もしあなたがこのセンターのメンバーになったら何を研究されますか?

ハラリ氏

人間同士の信頼関係をいかに回復するかを研究テーマにするでしょう。私たちが今世界で目にしているのは、人間同士の信頼関係の崩壊だからです。世界における最大の危機は、AIではありません。人間同士が信頼し合い、協力し合うことができれば、AIを安全に開発する方法を考え出すことができるでしょう。AI革命を危険なものにしているのは、人間同士の不信感です。AIをコントロール下に置くために、人間同士の十分な信頼関係を築くことは今からでも遅くありません。

塾長

この課題に取り組むために、あなたならどのようなアプローチをとりますか?

ハラリ氏

だからこそ今、学際的な研究拠点が求められています。生物学や心理学からの知見が必要です。遺伝子について理解する必要があります。また、チンパンジーがどのように信頼関係を築くか、からも多くのことが学べます。もちろん経済学やコンピュータ科学からの知見も必要です。人間同士の信頼関係の構築に関する多くの教訓は、10年、20年前までは通用しましたが、今では時代遅れになっています。なぜなら、今私たちはコンピュータを通じてコミュニケーションをとっているからです。

子供の死亡率や疾病率を見ればすべてが減少しています。しかし、人々は怒り、苛立ち、互いに話し合うこともできない状態です。何が起こったのか?新しいテクノロジーが人間の間に入り込み、コミュニケーションのほとんどが人間ではないエージェントによって媒介されるようになりました。だからといって、スマートフォンもコンピュータもすべて捨てましょう、とは言えません。テクノロジーを媒介にした上で、人間同士の信頼を築く方法を考え直す必要があるのです。

それぞれができることを行う

塾長

あなたの本はアカデミックなものとは一線を画し、読みやすい内容になっています。意図的にそうしているのでしょうか?

ハラリ氏

もちろんです。私の役割は、学術界の架け橋を作ることだと考えています。多くの場合、専門家は、他分野の専門家や学術的背景を持たない人と会話するのが難しい状態です。そのため私は、学術界の最新の理論やモデル、知見を取り上げ、それを高校生や、AI革命とは何かを知りたい人たちにも理解できるように説明することを心がけました。AI革命とは何か、情報の歴史とは何かを、コンピュータを学んだことのない私でもわかりやすい言葉で理解できるだろうか。それがこの本を書いた目的でした。

塾長

あなたの思いはサイバースペースに生きる人々に響いていると思いますか?

ハラリ氏

本を書いて世に送り出し、それが実際に人々にどのような影響を与えるのかを知ることは難しいことです。私はパートナーと共に、「ソーシャル・インパクト・カンパニー」という会社を10年ほど前に立ち上げました。私が本の執筆を担当し、彼はビジネス面のすべてを担当しています。20人のメンバーが働いています。ソーシャルメディアでの発信も行っており、本に書いた考えをより多くの人に届けられるようにしています。これが十分かどうかはわかりませんが、私たちは自分たちができることを行い、自分にできないことはできる人たちに託したいと思います。誰でも自分の肩だけで世界全体を背負うことはできません。各々が自分にできることをすればまだ間に合います。

塾長

トランプ政権が始まり、世界的に様々な動きがありますが、これをどう見ていますか?

ハラリ氏

社会内および社会間の信頼が急速に失われているため、非常に憂慮すべき事態です。第二次世界大戦後に確立された国際秩序が今、崩壊しつつあることが見て取れます。当時、最も重要なルールは、強い国が弱い国を単に侵略し征服してはならないというものでした。これは、強い国が弱い隣国を征服し、より大きな国や帝国を築くことが一般的であった数千年にわたるそれ以前の歴史とは全く対照的でした。21世紀初頭まで、人類はその歴史上最も平和で繁栄した時代を享受していました。その主な理由は、このルールが維持されていたからです。

中東やイスラエルなど世界の多くの地域では紛争が絶えません。もちろん、どこも完璧な状況ではないことは私もよく承知していますが、それ以前の状況に比べれば、はるかに良くなりました。このことは、各国政府の予算を見ればよく分かります。歴史上ほとんどの期間において、王や将軍、皇帝の予算の50%以上が軍事費に費やされていましたが、21世紀初頭には6~7%にまで減少しました。一方、医療費は約10%になりました。世界中の政府が医療費に軍事費以上の予算を費やしたのは、人類史上初めてのことでした。

しかし今、状況は逆の方向に進んでいます。ロシアによるウクライナ侵攻の結果、米国の国防予算は急増し、医療や教育が犠牲になっています。トランプ大統領の世界秩序の考え方は、弱者は強者に従うのが当然であり、従わない場合は生じる紛争は自己責任であるというものです。このような論理は、人類を絶え間ない戦争状態へと逆戻りさせてしまいます。その結果、医療や教育の予算が削減されるだけでなく、AIの競争で敗れた者は勝者をずっと追いかけるしかないため、AIの規制も不可能になります。

塾長

しかし、あなたの本は私たちに希望を与えてくれています。まだ希望はあります。これから数年の間に人々が正しいことをすれば人類は大丈夫でしょう。

■学生との質疑応答

学生

AIが進化したことでAI自体がネットワークを作るようになりましたが、人間同士では分断が進んでいます。ホモ・サピエンスにはグループを維持する特別な能力があり、そこにはこれまで広く共有されてきた物語(間主観的現実)が重要な役割を果たしてきたと述べられていましたが、これは今後どのような役割を果たすと思われますか?

ハラリ氏

ホモ・サピエンスとしての私たちの優れた能力は、何千、何億、何兆もの人々による非常に大きな協力関係を、共有された物語を通じて構築することです。その最も成功した例は、おそらくお金でしょう。お金は、誰もが信じる唯一の物語です。

しかし今これは暗号通貨によって脅かされています。「ドルはいらない、暗号通貨が欲しい」と言う人々が増えているからです。これは無視できない兆候です。ドルは銀行のような人間の機関によって生み出されていますが、ビットコインやイーサリアムのような暗号通貨は、アルゴリズムによって生み出されるポスト・ヒューマンな通貨です。つまり、ドルは信用せず、ビットコインは信用すると言う人々は、人間よりもアルゴリズムを信用すると言っているのです。

イーロン・マスクやトランプは、何万人もの人間の官僚を解雇していますが、彼らは官僚制度に反対しているわけではありません。人間の官僚制を、アルゴリズムによるデジタルの官僚制に置き換えようとしているだけです。

ソーシャルメディア以前は、世の中に出回るストーリーはすべて人間の頭から生まれたもので、どのストーリーが話題を独占するかを決めるのは人間の編集者でした。新聞社やテレビ局の編集者が、その日発表されたすべての記事に目を通し、どれが最も重要な記事かを決めていました。しかし、今これを行っているのはアルゴリズムです。人間以外の存在によりストーリーが作られ、拡散されています。

また、表現の自由と情報の自由を区別する必要があります。表現の自由は人権であり、守られるべきものです。TikTok上であれ、フェイスブック上であれ、どこであろうと、極端な状況を除き、人間は罰せられることを恐れずに自分の意見を表明する権利を持つべきです。

一方、情報の自由はそれとはまったく異なるものです。AIやアルゴリズム、Botに与えられた新しい権利です。ソーシャルメディア大手企業の多くは、この2つの権利を意図的に混同させています。ソーシャルメディアにおける問題は、人間が嘘をつくことではありません。人間は何千年もの間、嘘をついてきました。問題は、意図的に嘘や憎悪を広めるアルゴリズムにあります。これは止めるべきで、罰するべきです。

もし私がYouTubeユーザーで、偽の動画を作成したとしても、それが害を及ぼさない限り、必ずしも処罰されるべきではありません。しかし、私が企業で、憎悪に満ちた陰謀論を意図的に何百万人もの人々に推奨し、再生して、そこから利益を得ているのであれば、私は責任を問われるべきでしょう。この場合、表現の自由は保護されません。これはアルゴリズムによって行われており、アルゴリズムには権利がないからです。ソーシャルメディア企業は、新聞社やテレビ局と同じように、何かを発信する前に、それが真実であり、憎悪に満ちた嘘でないことを確認すべきです。

学生

かつて、国家の有する財産は、天然資源などの有形の富でした。しかし、現在では、データやテクノロジーを用いた無形の資産へと変化しています。AIを用いたサイバー戦争はすでに行われていますが、それでもロシア・ウクライナ戦争のように、爆撃や生身の人間を殺害する悲劇は終わっていません。この先、いくら高知能AIが発達したとしても、憎悪の感情を持つ人間が存在する限り、戦争の残虐性は残り続けるのでしょうか。

ハラリ氏

情報技術の発展が物理的世界を消滅させることはありません。憲法であれ、宗教であれ、お金であれ、人間が作り出したすべての情報は、物理世界を置き換えたり、消滅させたりするものではありません。人間はまだ肉体を持っており、食べる必要があり、きれいな水が必要です。

そして戦争は結局のところ、人を殺すことに変わりありません。ただ、そのやり方は変わりつつあります。多くの人が、実際の銃撃はAIがするだろうと思っていましたが、依然として人間が行っています。AIがしているのは、標的をどこにするかの決定で、それはここ2、3年の間に起こったことです。以前は、標的を特定する仕事は人間の将校が行っていました。彼らはあらゆる情報を集め、爆撃先を決めるのに何日もかかっていました。しかし今はそれをAIが数秒でやってくれます。AIは、人間には分析できない膨大な量の情報に目を通し、パターンを見つけ出し、数秒以内に、「これは敵の司令部だ、爆撃しろ」と言います。

これは統計的確率と非常に複雑な数学的モデルを使って行われます。ここで重要なのはAIを信じるかということです。AIはミスを犯すかもしれません。軍事用ではなく民間のビルを爆撃するよう指示するかもしれません。ある人は、AIが標的を示した後、人間の分析官がすべての情報に目を通し、間違いがないか確認すると言いますが、別の人は、確認には30秒もかけていないと言います。誰もAIを本当にチェックすることはできません 将来を見据えると、5年後、10年後には、AIが戦争においてさらに重要な意思決定を行うようになるでしょう。これは非常に危険なことです。

学生

『ホモ・デウス』の中で、COVID-19のワクチン開発が非常に大きな進歩だったと書かれていましたが、当時は反科学的な思想や陰謀論も多く出回りました。また同じように反科学的思想が沸き起こった場合、どのような対策が可能でしょうか。

ハラリ氏

反科学的な思想や陰謀論は新しいものではありません。歴史上ずっと存在してきました。真実は複雑で、フィクションは単純です。パンデミックの真実は非常に複雑です。人類は歴史の大半において、ウイルスの存在を知りませんでした。私たちはウイルスが何であるかを理解し始めたばかりで、科学界では大きな論争が繰り広げられています。ウイルスは、細菌のように何かを食べて増殖するわけではありません。ウイルスは遺伝子情報のかけらなのです。そして、これの驚くべき能力は、人間の体の細胞に入り込み、細胞がそのコードのコピーをさらに作り始めるように仕向けることです。それが人間の体を乗っ取るのです。

これはとても奇妙なことです。私たちが容易に認識できる現実レベルでは、このようなことは起こりません。そのため、パンデミックがどのように始まり、どのように広がっていくのかを理解するのはとても困難です。陰謀説を信じる方がずっと簡単です。歴史家として言えることは、この種の陰謀論は常に間違っているということです。

アメリカはイラクへ侵攻した時、彼らは世界最強の国であらゆる軍事力を持っていたのに失敗しました。最終的にはイランが主な受益者となり、戦争の勝利者となりました。つまり、アメリカは計画を立てたが、まったく違う結果になったということです。これが現実です。陰謀論というのは大抵の場合、世界は非常に単純な場所だという希望的観測に基づくもので、数人が世界征服を計画し、それを実行に移すというストーリーになっています。現実はそんなに単純ではありません。

学生

今、私たちが生きているソーシャルメディアの世界では、YouTubeやX、TikTokが広く浸透しており、そこに楽しみや娯楽を見出す流れがありますが、今後AIの世界では、楽しみや娯楽はどう変化していくと思われますか?

ハラリ氏

これまでの歴史では、詩であれ演劇であれ、テレビであれ映画であれ、すべての娯楽は人間の想像力から生まれてきました。今私たちは、人間よりもはるかに安く、効率的に、そして人間の想像力の限界を超えたものを生み出せるものを手に入れました。人間の想像力は、脳や生物学的な限界により制限されますが、AIにはそれがありません。

例を挙げると、2016年にAlphaGoと囲碁の世界チャンピオンである李世ドルとの非常に有名な対局がありました。この対局での注目すべき点は、AIが世界チャンピオンを破ったことだけではありません。人類は何千年も前から東アジアで囲碁を打っており、今に至るまでAlphaGoのような打ち方を誰も考えつきませんでした。そこへAlphaGoが登場し、こんな打ち方もできるよと言ってきたのです。同じことが音楽、絵画、演劇、テレビでも起こるでしょうし、すでに起こっています。

今、多くの人々がAIを利用した動画制作に取り組んでいますが、その始まりを示しています。他の分野と同じように、娯楽の形も完全に変わっていくでしょうが、どう変わっていくかは予測できません。AIがやろうとすることを予測できるのであれば、それはAIではありません。

学生

インターネットのさらなる利便性により、人々の価値観がより多様化する中で、正しい情報というものが必ずしも出回らなくなり、正しい情報を知る人がマジョリティになり得ない状態が想像できますが、そのような中で人間はどのように合意を取っていくことができるでしょうか。

ハラリ氏

人間同士のコミュニケーションが新しい情報技術によって操作されている時代に、どうやって人間同士の合意に達するのか、私にもまだわかりません。科学において重要なことのひとつは、無知を認めることです。科学が発展する前、人間は言っていました。自分たちはすべてを知っている、すべては聖典に書かれている、新たな研究は必要ない、と。

そこに「これを知りたいがわからない。だから研究が必要だ」という発想が生まれ、科学革命が始まりました。それは今も同じです。最も重要な研究として何を選ぶかと問われれば、新たなテクノロジーを通じてコミュニケーションを図る際に、人間同士の信頼関係をどのように構築するか、これをテーマにします。何千年もの間、私たちが信頼関係の構築について学んできたことが通用しなくなってきています。そして、このテーマに焦点を当てる研究者をもっと増やす必要があります。

学生

将来出てくるAIがエージェントとして働くのであれば、人間がこれまでリードしてきた研究に対し、AIがリードする研究というのはどのようになっていくのでしょうか。

ハラリ氏

AIは科学研究にも革命を起こしつつあります。ノーベル物理学賞と化学賞の両方がAI分野に贈られました。特に、アルファフォールドの開発者にノーベル化学賞が贈られたことに驚きました。アルファフォールドを開発するためには化学の知識が必要でしたが、彼らの元々の専門は化学ではありません。しかし、彼らの発見は化学を変え、生物学を変え、タンパク質の折り畳み方を予測するという巨大な科学的パズルを解くことによって医学を変えました。ここからわかるのは、AIがより多くの分野で人間より優れた存在になることだけでなく、AIが分野の壁を打ち破ることができるということです。

人間の能力には限りがあります。物理学、経済学、化学、歴史学、それぞれすべてを深く学ぶ時間はありません。しかし、AIにはそのような限界がありません。そのため10年後には、各学問分野を深く理解し、それぞれのデータやモデルを組み合わせて人間にはできないレベルの発見をするAIが出てくるかもしれません。

■最後にハラリ氏より

考えなければならないこと、研究しなければならないことはたくさんあります。AIを開発する企業の人たちが、AIのポジティブな可能性を語っていますが、メリットとリスクとバランスを取るためには、哲学者や歴史家、批評家が必要なのです。そのため私は講演の場では、そのリスクに焦点を当てて話します。しかしも莫大なプラスの可能性もあるのです。AI開発を止めたいのではなく、それを安全に進めたいだけなのです。ここで重要なのが、人間同士の信頼関係を築くことにあります。他者や自分の外側にあるものを信頼できなければ、1分たりとも生きることはできないという意味で、信頼はまさに生命の基盤なのです。私たちを取り巻く空気を信頼できなければ息はできません。世界には大きな問題がありますが、究極的には、生命の基盤は信頼です。

写真:岸 剛史

文章:鈴木薫